Filtr Google to zestaw reguł i algorytmów zastosowanych przez wyszukiwarkę Google, mających na celu identyfikację i penalizację stron internetowych, które naruszają wytyczne dla webmasterów lub stosują techniki optymalizacji uznane za manipulacyjne. Nałożenie filtra przez Google zwykle skutkuje obniżeniem pozycji strony w wynikach wyszukiwania dla określonych słów kluczowych lub całkowitą jej deindeksacją.

Filtry od Google nakładane są za różne naruszenia, takie jak:

- manipulowanie rankingiem za pomocą nieetycznych praktyk SEO (ang. Black Hat SEO),

- nadmierne stosowanie słów kluczowych (ang. keyword stuffing),

- niewłaściwe linkowanie (ang. link scheming),

- ukrywanie treści (ang. cloaking),

- tworzenie stron o niskiej jakości (ang. webspam, doorway pages).

Filtry mogą być także nałożone za techniczne niedociągnięcia związane ze stroną, takie jak problemy z bezpieczeństwem, szybkością wczytywania strony czy zgodnością z urządzeniami mobilnymi.

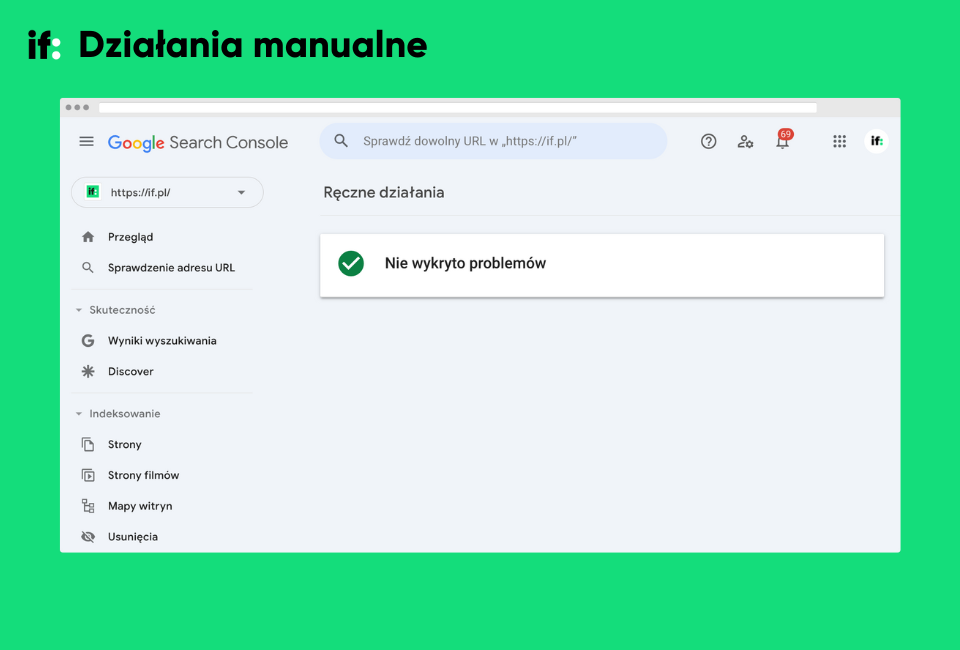

Filtr ręczny a algorytmiczny

Istnieje zasadnicza różnica między filtrem ręcznym a algorytmicznym. Filtry ręczne są nakładane przez zespół Google po manualnej analizie strony, która została zgłoszona lub wykryta jako potencjalnie naruszająca wytyczne dla webmasterów. Gdy na stronę nałożony jest filtr ręczny, webmaster zazwyczaj otrzymuje powiadomienie w Google Search Console z opisem naruszenia i sugestią, jak je naprawić.

Filtry algorytmiczne są automatycznie nakładane przez algorytmy Google, które ciągle monitorują i oceniają strony internetowe – to Panda, Penguin, Phantom, Top Heavy, Product Review, Medic Update itp.

Jeśli algorytm wykryje potencjalne naruszenie wytycznych, może nałożyć filtr na stronę, co zazwyczaj objawia się gwałtownym spadkiem rankingu. W tym przypadku Google nie wysyła powiadomień o nałożeniu filtra algorytmicznego. Jedynym sposobem na jego wykrycie jest monitorowanie ruchu i rankingu strony, a następnie analizowanie, czy nastąpiły znaczne zmiany w okresie aktualizacji algorytmu.

Najpopularniejsze filtry i aktualizacje algorytmów Google

W kontekście filtrów algorytmicznych często wskazuje się kilka najważniejszych aktualizacji Google, które na przestrzeni lat najmocniej wpływały na widoczność stron w wynikach wyszukiwania. Choć nie każda z nich była formalnie „filtrem” w ścisłym znaczeniu, w praktyce mogły one prowadzić do spadków pozycji i ruchu organicznego.

- Google Panda – algorytm ukierunkowany na ocenę jakości treści. Uderzał przede wszystkim w strony posiadające zduplikowane, bardzo krótkie, mało wartościowe lub masowo generowane treści.

- Google Penguin – aktualizacja koncentrująca się na profilach linków przychodzących. Jej celem było ograniczenie skuteczności sztucznego pozyskiwania linków, systemów wymiany linków oraz anchorów nadmiernie zoptymalizowanych pod frazy kluczowe.

- Google Phantom – potoczna nazwa aktualizacji związanych z oceną jakości strony i doświadczenia użytkownika. Dotyczyła m.in. serwisów o niskiej wartości treści oraz nieodpowiadających intencji użytkownika.

- Top Heavy – algorytm wymierzony w strony, na których nadmierna liczba reklam (szczególnie w górnej części strony) utrudniała dostęp do właściwej treści.

- Product Review Update – aktualizacja skupiona na jakości recenzji produktów. Promuje treści eksperckie, szczegółowe i oparte na rzeczywistym doświadczeniu, a obniża widoczność powierzchownych opisów.

- Medic Update – szeroka aktualizacja algorytmu (Core Update), która szczególnie dotknęła strony z obszaru YMYL (Your Money Your Life), wymagające wysokiej wiarygodności, autorytetu i eksperckości (E-E-A-T).